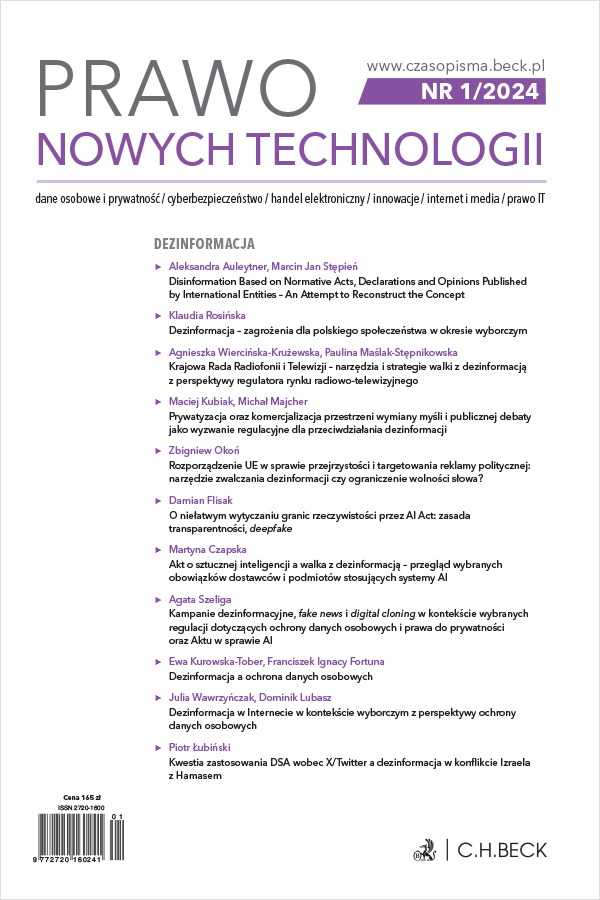

Opis

Aktualne problemy stosowania prawa nowych technologii w kontekście najnowszych regulacji!

W numerze 1/2024 polecamy:

DEZINFORMACJA

Aleksandra Auleytner, Marcin Jan Stępień, „Disinformation Based on Normative Acts, Declarations and Opinions Published by International Entities – An Attempt to Reconstruct the Concept”

Although the problem of disinformation has been addressed in reports and opinions prepared by international organisations and European Union for several years now, it has recently gained significant importance due to its use as an element of hybrid warfare and for short-term political and economic objectives. The regulation of disinformation is increasingly being incorporated into international, EU and national regulations. Despite this, however, there remains no consensus on the definition of disinformation. Many normative acts and reports use the term 'disinformation’ without providing any definition, while the definition proposed in other acts varies considerably. The aim of this article is to compare a selection of acts, declarations and opinions published by international organisations that address the issue of disinformation. On this basis, the authors will seek a common meaning of „disinformation” from among various statements from international actors.

Klaudia Rosińska, „Dezinformacja – zagrożenia dla polskiego społeczeństwa w okresie wyborczym”

W artykule poruszone zostały zagadnienia dotyczące zdefiniowania zjawiska dezinformacji zarówno intencjonalnej, jak i niezamierzonej, rozpoznania jej aktorów (świadomych i nieświadomych) oraz celów i strategii wykorzystywanych do dezinformacji w okresie wyborczym. Przedstawione zostały narracje dezinformacyjne podważające zaufanie do instytucji publicznych, ze szczególnym uwzględnieniem dezinformacji antyukraińskiej w 2023 r. Zaproponowano także rozwiązania zarówno z perspektywy zmian w prawie oraz skutecznego komunikowania zagrożeń związanych z dezinformacją przez instytucje publiczne. W artykule poruszono też zagadnienie odpowiedzialności korporacji Big Tech za rozprzestrzenianie dezinformacji i potencjału egzekwowania zmian w funkcjonowaniu mediów społecznościowych.

Agnieszka Wiercińska-Krużewska, Paulina Maślak-Stępnikowska, „Krajowa Rada Radiofonii i Telewizji – narzędzia i strategie walki z dezinformacją z perspektywy regulatora rynku radiowo-telewizyjnego”

Dezinformacja to zjawisko nie tylko często przebijające się w debacie publicznej, ale także realne zagrożenie dla funkcjonowania państwa i społeczeństwa. Organizacje międzynarodowe i branżowe zrzeszenia podejmują działania zmierzające do wypracowywania dobrych praktyk mających na celu przeciwdziałanie i zwalczanie tego zjawiska. Krajowe organy regulujące rynek mediów nie dysponują jednak efektywnymi narzędziami prewencyjnymi ani kontrolnymi w tym obszarze. Próbują więc wykorzystywać wynikające z przepisów prawa kompetencje, choć nie zawsze w sposób zgodny z duchem regulacji. Artykuł przedstawia analizę takich działań.

Maciej Kubiak, Michał Majcher, „Prywatyzacja oraz komercjalizacja przestrzeni wymiany myśli i publicznej debaty jako wyzwanie regulacyjne dla przeciwdziałania dezinformacji”

W dzisiejszym społeczeństwie informacyjnym platformy internetowe nie tylko dostarczają rozrywkę, lecz stają się współczesną agorą – przestrzenią debaty, wymiany myśli i informacji oraz realizacji celów politycznych. Wyzwania związane z dezinformacją i treściami nielegalnymi motywują dzisiejszych prawodawców do stworzenia bezpiecznego środowiska internetowego, co jednak nie jest zadaniem prostym. Balansowanie między wolnością słowa a zwalczaniem dezinformacji staje się poważnym wyzwaniem, któremu stara się sprostać Unia Europejska. W artykule zestawiono ze sobą regulacje regulaminów platform i przepisy DSA. Praktyka pokazuje jednak, że platformy różnie postępują z wolnością słowa, a stosowane algorytmy mogą prowadzić do rozwoju prywatnej cenzury pod pretekstem dozwolonej moderacji.

Maria Dymitruk, „Akt o usługach cyfrowych w czasach ChatGPT: czy dostawcy generatywnej AI są pośrednikami internetowymi?”

Artykuł poświęcony został odpowiedzi na pytanie, czy dostawcy modeli generatywnej sztucznej inteligencji (AI) objęci są regulacją Aktu o usługach cyfrowych. Rozważania prawne podzielone zostały na sześć części. W pierwszej przedstawiono analizę zagrożeń prawnych tworzonych przez duże modele językowe. Kolejna część poświęcona jest badaniu ram regulacyjnych rynku generatywnej sztucznej inteligencji. Następnie omówiony został zakres zastosowania Aktu o usługach cyfrowych. Szczegółowa analiza w czwartej i piątej części dotyczy kwalifikacji dostawców generatywnej AI odpowiednio jako pośredników internetowych i dostawców wyszukiwarek internetowych. Artykuł kończą refleksje na temat niewystarczającej precyzji definicyjnej unijnej regulacji usług cyfrowych oraz postulat dostosowania przepisów rozporządzenia do kreowanej przez duże modele językowe rzeczywistości internetowej.

Zbigniew Okoń, „Rozporządzenie UE w sprawie przejrzystości i targetowania reklamy politycznej: narzędzie zwalczania dezinformacji czy ograniczenie wolności słowa?”

Zaledwie kilka miesięcy przed wyborami do Parlamentu Europejskiego, 27.2.2024 r., Parlament Europejski przyjął ostateczny tekst rozporządzenia w sprawie targetowania i przejrzystości reklam politycznych. Rozporządzenie ustanawia obowiązki w zakresie przejrzystości reklam politycznych, polegające na odpowiednim oznaczaniu reklam politycznych i zapewnieniu ich repozytoriów, a także ogranicza rodzaje danych osobowych, które mogą być wykorzystane do targetowania reklam politycznych. Jego adresatami są sponsorzy reklamy politycznej (kandydaci, partie lub organizacje prowadzące kampanię), podmioty świadczące usługi reklamy politycznej oraz wydawcy, którzy znajdują się głównie na końcu łańcucha wartości reklamy politycznej, publikując i rozpowszechniając reklamę za pośrednictwem dowolnego medium, w tym za pomocą platform internetowych.

Damian Flisak, „O niełatwym wytyczaniu granic rzeczywistości przez AI Act: zasada transparentności, deepfake”

Deepfake jest pojęciem, które relatywnie niedawno wzbogaciło – chciałoby się powiedzieć „niestety” – słownik wyrazów, jakie najnowsze technologie wniosły do naszego życia i prawa. Według powszechnego rozumienia, które okazuje się być istotnie węższe od znaczenia nadanego na gruncie Aktu w sprawie sztucznej inteligencji, termin ten oznacza nakierowane na wywołania negatywnych konsekwencji, cyfrowe wytworzenie, ingerencję lub manipulację rzeczywistym obrazem osób. O ile jeszcze do niedawna sporządzenie zmanipulowanego, lecz realistycznego obrazu, mogło powodować trudności, dostęp do odpowiednich narzędzi stał się obecnie właściwie bezproblemowy. Wraz z tą swoistą demokratyzacją dostępu do środków upozorowania rzeczywistych obrazów dramatycznie wzrosła liczba takich treści. Mowa tutaj o szczególnie odrażających przypadkach nieautoryzowanego wykorzystania wizerunków w ujęciach pornograficznych, poprzez treści wykorzystujące naiwność dzieci lub brak doświadczenia życiowego osób starszych, aż po cały wachlarz mechanizmów antydemokratycznego oddziaływania na nastroje społeczeństwa w okresach przedwyborczych.

Martyna Czapska, „Akt o sztucznej inteligencji a walka z dezinformacją – przegląd wybranych obowiązków dostawców i podmiotów stosujących systemy AI”

Artykuł zawiera przegląd obowiązków nałożonych w Akcie ds. sztucznej inteligencji na dostawców i podmioty stosujące systemy AI odnoszących się do systemów AI wysokiego ryzyka, systemów AI ogólnego przeznaczenia oraz obowiązków w zakresie transparentności, które mogą służyć walce z dezinformacją.

Agata Szeliga, „Kampanie dezinformacyjne, fake news i digital cloning w kontekście wybranych regulacji dotyczących ochrony danych osobowych i prawa do prywatności oraz Aktu w sprawie AI”

Aktualne regulacje dotyczące ochrony danych osobowych i prawa do prywatności nie umożliwiają skutecznej walki z dezinformacją i fałszywymi wiadomościami (fake news) w dobie sztucznej inteligencji. Są one rozproszone po wielu aktach zapewniających fragmentaryczną ochronę. Akt w sprawie sztucznej inteligencji wprowadza obowiązek znakowania wyników działania systemów AI przez dostawców oraz wygenerowanych lub zmodyfikowanych deepfake przez ich twórców. Obowiązki te mogą jednak nie być wystarczające z uwagi na opóźnienie ich wejścia w życie i rozwój technologii.

Ewa Kurowska-Tober, Franciszek Ignacy Fortuna, „Dezinformacja a ochrona danych osobowych”

Postępujący współcześnie rozwój technologii, w tym tzw. generatywnej sztucznej inteligencji, sprawia, że coraz powszechniejsze staje się zjawisko dezinformacji. Przybiera ona współcześnie rozmaite formy: od fake newsów, przez deepfake, po cyberterroryzm. Osoby ją szerzące mogą naruszać szereg norm prawnych, w tym te z zakresu ochrony danych osobowych. W artykule dokonujemy analizy genezy oraz najważniejszych przykładów naruszania ochrony danych osobowych poprzez działalność o charakterze dezinformacyjnym.

Julia Wawrzyńczak, Dominik Lubasz, „Dezinformacja w Internecie w kontekście wyborczym z perspektywy ochrony danych osobowych”

Działania dezinformacyjne polegające na rozpowszechnianiu fałszywych lub wprowadzających w błąd treści w celu manipulacjipercepcjami i opiniami społeczeństwa, a tym samym wywarcia wpływu na decyzje i postawy wyborców – mogą znaczącozakłócić uczciwy i transparentny przebieg wyborów. Stąd tak istotne jest zgodne z prawem przetwarzanie danych osobowych,które w kontekście wyborczym stanowić może oręż partii politycznych do pokonania rywali.

Piotr Łubiński, „Kwestia zastosowania DSA wobec X/Twitter a dezinformacja w konflikcie Izraela z Hamasem”

Celem artykułu jest przedstawienie zjawiska dezinformacji w kontekście zastosowania Aktu o usługach cyfrowych, na przykładzie ostatniej eskalacji konfliktu zbrojnego między Hamasem a Izraelem. Artykuł skupia się na postępowaniu Komisji w sprawie X/Twittera, które zostało wszczęte 18.12.2023 r. W artykule podkreślono fakt, że X/Twitter jest wykorzystywany w sposób niezgodny z prawami podstawowymi, w szczególności wskazano na zaniechania platformy w zwalczaniu dezinformacji, treści terrorystycznych, treści przemocowych i mowy nienawiści.Artykuł zawiera nie tylko rozważania prawne, ale umieszcza postępowanie w sprawie X/Twittera w szerszym kontekście bezpieczeństwa międzynarodowego. Ma to na celu wskazanie zagrożeń wynikających z bierności wobec działalności platform mediów społecznościowych.

Opinie

Na razie nie ma opinii o produkcie.